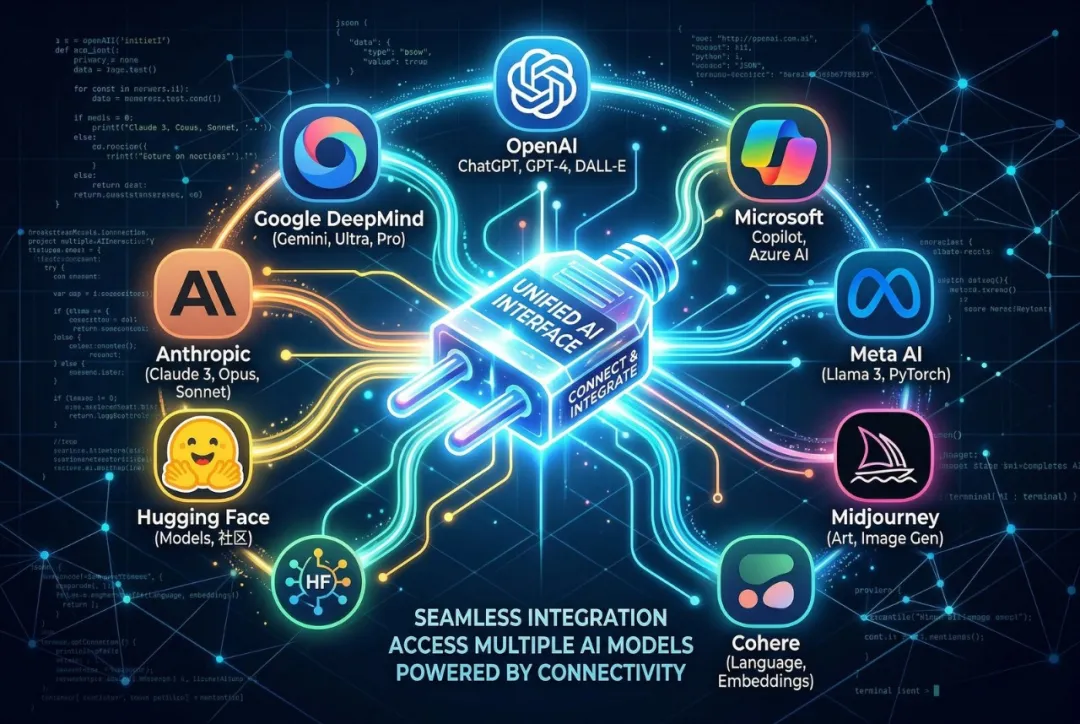

还在为不同 AI 模型的 API 接口各异而头疼?开源项目 LiteLLM 提供了一个标准化的 OpenAI 兼容接口,让你用同一套代码轻松调用 GPT、Claude、本地模型等众多 LLM,极大提升开发效率。

如果你是一名开发者,正为项目需要对接多个不同的大型语言模型(LLM)提供商而烦恼——每个提供商的 API 接口、参数格式都不尽相同,调试和维护成本高昂。那么,BerriAI 开源的 LiteLLM 正是为你量身打造的解决方案。

✨ 核心亮点与强大功能

统一接口:所有模型调用都遵循 OpenAI API 格式,大幅降低学习与集成成本。

多模型支持:覆盖主流云服务厂商和开源模型,一键切换,无需修改核心业务代码。

成本与使用量追踪:内置功能帮助监控不同模型的使用情况和花费。

故障转移与重试:当某个模型或服务出现问题时,可自动切换到备用模型,保障服务稳定性。

自托管代理服务器:提供代理服务,可以集中管理模型密钥、实现速率限制和访问控制,适合团队协作与生产环境。

这些功能使得 LiteLLM 不仅适用于快速原型开发,也能轻松应对企业级、混合云等复杂部署场景。

🔧 低门槛快速上手

LiteLLM 的上手非常简单。对于 Python 开发者,可以通过 pip 直接安装,并在代码中通过几行配置即可开始调用。项目文档提供了丰富的示例,从基础调用到高级功能如流式响应、异步处理都有涵盖。

此外,项目还提供了 Docker 镜像、Helm Chart 和 Terraform 模块,方便你快速将 LiteLLM 代理服务器部署到各种云环境或本地基础设施中,实现模型的统一管理和安全调用。

💡 适用场景与使用建议

多模型实验与评估:需要快速对比不同模型在特定任务上的效果和成本。

生产环境模型路由:根据请求内容、成本或性能要求,动态选择最合适的模型。

简化后端架构:用一套后端代码支持前端对接多个 AI 模型提供商。

企业内部 AI 平台:统一管理对内外各种模型服务的访问权限和密钥。

建议初次使用者先从 Python SDK 开始,体验统一调用的便捷。当有团队协作或生产部署需求时,再深入研究其代理服务器功能。

🌟 强烈推荐与行动指南

总而言之,LiteLLM 以其出色的设计,解决了 LLM 应用开发中模型接口碎片化的核心痛点。它极大地提升了开发灵活性与效率,是 AI 应用开发者工具箱中不可或缺的利器。

项目仓库地址:https://github.com/BerriAI/litellm

不妨现在就点个 Star🌟 收藏起来,并 clone 代码库亲自试用一下吧!如果你已经在使用或有独特的应用场景,欢迎在评论区分享你的体验与见解,一起交流学习!

🌟 总结与行动建议

如果这篇内容对你有帮助,建议先收藏,再结合你的场景拆成下一步执行清单。

更多内容欢迎关注公众号: